Récemment, Apple a ouvert le dialogue autour de la protection des données à travers son Workshop sur l’apprentissage automatique respectant la vie privée. Pendant cet événement, des experts ont partagé leurs réflexions sur la sécurité et la responsabilité dans le développement de l’apprentissage automatique. Maintenant, ces présentations sont accessibles au public et permettent de mettre en lumière des travaux essentiels dans ce domaine.

La privacy différentielle : approche d’Apple

Un thème constant dans ces études est la privacy différentielle, méthode privilégiée par Apple. Cette stratégie consiste à introduire un bruit statique dans les données utilisateur avant leur envoi aux serveurs, rendant ainsi impossible l’identification individuelle en cas d’interception des données.

En d’autres termes, cette technique permet d’assurer que seules des tendances statistiques sont visibles, tout en préservant l’anonymat des utilisateurs. Apple résume sa démarche en affirmant que ce bruit, légèrement biaisé, aide à masquer les données personnelles, garantissant ainsi une certaine forme de sécurité.

La technologie de privacy différentielle d’Apple repose sur l’idée que le bruit peut camoufler les données individuelles, si de nombreuses personnes fournissent les mêmes informations, le nourrir peut s’amoindrir à mesure que de nouveaux points de données s’ajoutent.

Trois projets remarquables présentés par Apple

1: La confidentialité pan-locale pour l’analyse fédérée, par Guy Rothblum (Apple)

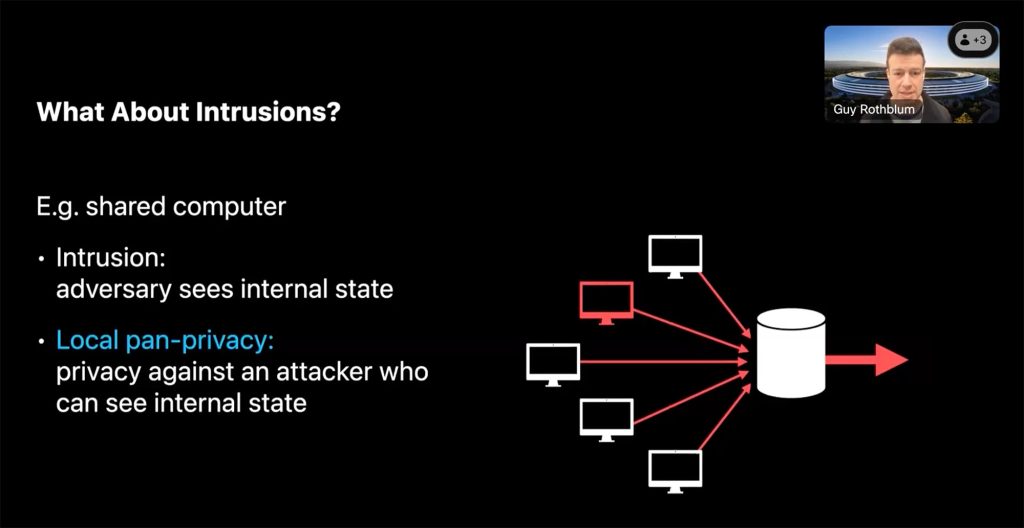

Ce projet, publié en mars, s’appuie sur des recherches antérieures pour assurer la confidentialité des données même si un appareil est compromis. Il propose des méthodes cryptées innovantes permettant aux développeurs de recueillir des statistiques tout en préservant l’anonymat des utilisateurs.

Cette recherche révèle à quel point il est difficile d’extraire des données d’utilisation lorsque des dispositifs sont utilisés de manière inappropriée, tout en explorant des voies sécurisées pour permettre aux entreprises de recueillir des données pertinentes sans enfreindre la vie privée.

2: Recherche privée à grande échelle avec Wally, présenté par Rehan Rishi et Haris Mughees (Apple)

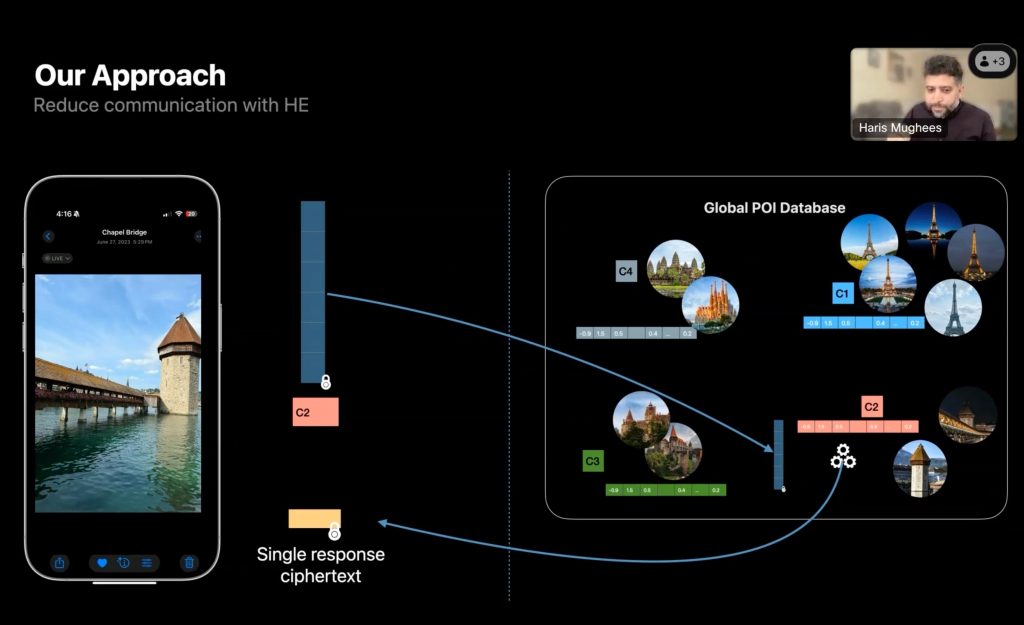

Wally permet à Apple de gérer les recherches cryptées tout en optimisant les coûts. Quand un utilisateur prend une photo d’un monument, par exemple, le traitement de cette image implique l’interaction avec des serveurs, ce qui pourrait poser des problèmes de confidentialité.

Ce projet démontre comment, en utilisant la privacy différentielle, Apple peut réduire la quantité de données fictives nécessaires tout en garantissant la protection des requêtes privées. À mesure que le nombre d’utilisateurs augmente, le bruit à transmettre diminue, facilitant ainsi la gestion des données.

3: Données synthétiques par la privacy différentielle via des APIs de modèle de fondation, présenté par Sivakanth Gopi (Microsoft Research)

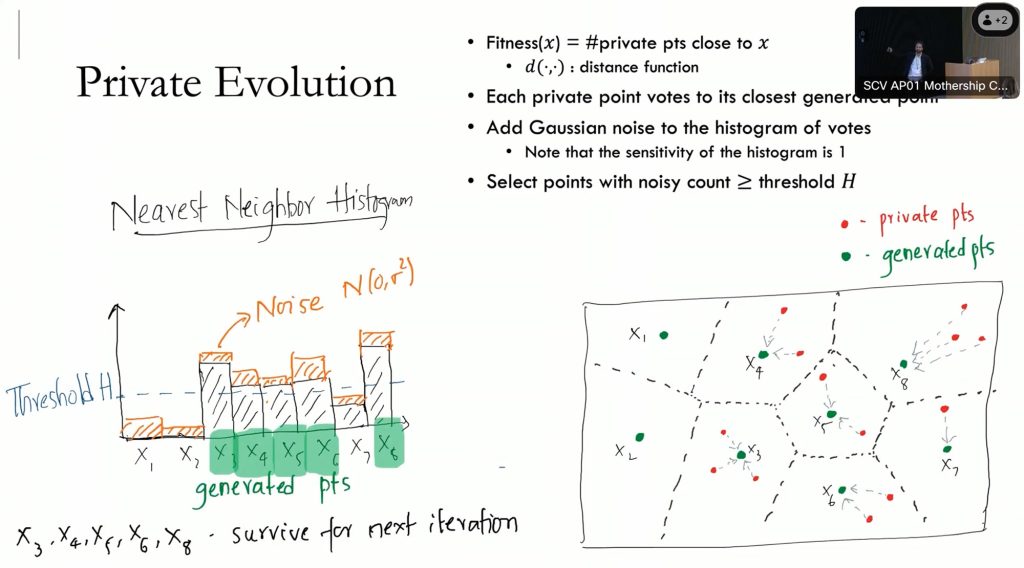

Cette recherche explore comment générer des données synthétiques de haute qualité à partir de données réelles tout en garantissant la confidentialité. Le défi réside dans la nécessité d’informations robustes pour former des modèles d’IA sans exposer les données des utilisateurs.

Les chercheurs introduisent le concept d’Évolution Privée (PE) pour créer des versions synthétiques de jeux de données originaux sans nécessiter un accès direct à ces données. Cette méthode est efficace et respecte la vie privée, ouvrant de nouvelles perspectives dans le domaine de l’IA.