Récemment, des chercheurs d’Apple ont fait une avancée notoire dans le domaine des modèles de génération de texte. Leur tout nouveau modèle se distingue par sa rapidité et son efficacité, permettant une rédaction jusqu’à 128 fois plus rapide que ses concurrents. Découvrons ensemble les détails de cette innovation fascinante.

Comprendre les modèles de diffusion

Pour appréhender cette avancée, il est essentiel de connaître les bases. Les modèles de langage (LLM) comme ChatGPT fonctionnent de manière autoregressive, produisant du texte token par token. À l’inverse, les modèles de diffusion créent plusieurs tokens simultanément et les perfectionnent à travers de nombreuses itérations.

Une catégorie spécifique de ces modèles, les modèles de match-flow, élimine le processus itératif, apprenant à générer un résultat final d’un seul coup. Cette méthode promet un gain de temps considérable tout en maintenant une qualité de texte élevée.

Le nouveau modèle d’Apple

Le modèle proposé par les chercheurs, intitulé « FS-DFM: Fast and Accurate Long Text Generation with Few-Step Diffusion Language Models », a démontré sa capacité à rédiger des passages complets en seulement huit cycles de perfectionnement. Ce rendu est comparable à ceux demandant plus de mille étapes via des modèles traditionnels.

Pour y parvenir, une approche en trois étapes a été mise en place. D’abord, le modèle est formé pour s’adapter à différents niveaux de raffinement. Ensuite, un modèle « enseignant » guide ses mises à jour, garantissant précision et pertinence. Enfin, des ajustements sont réalisés pour atteindre un résultat final en moins d’étapes.

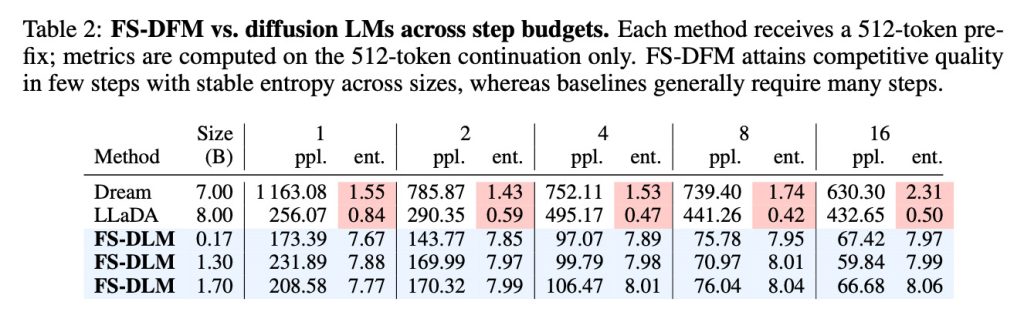

Les performances de FS-DFM sur les métriques de perplexité et d’entropie montrent clairement ses avantages. La perplexité, reflet de la qualité textuelle, doit être la plus basse possible pour un rendu naturel. L’entropie quant à elle évalue la confiance du modèle dans ses choix de mots, équilibrant répétition et diversité.

Pour illustrer la supériorité de FS-DFM, il a été comparé aux modèles de diffusion les plus avancés, comme ceux comprenant respectivement 7 et 8 milliards de paramètres. Les variantes de FS-DFM, dotées de seulement 1.7, 1.3, et 0.17 milliard de paramètres, ont systématiquement affiché une perplexité inférieure et une entropie plus stable.

Ce nouveau modèle pourrait s’avérer révolutionnaire, non seulement pour Apple, mais aussi pour l’ensemble de la recherche sur les modèles de langage. Les chercheurs ont annoncé leur intention de rendre les codes et modèles accessibles pour faciliter la reproduction et l’avancement des travaux futurs dans ce domaine.

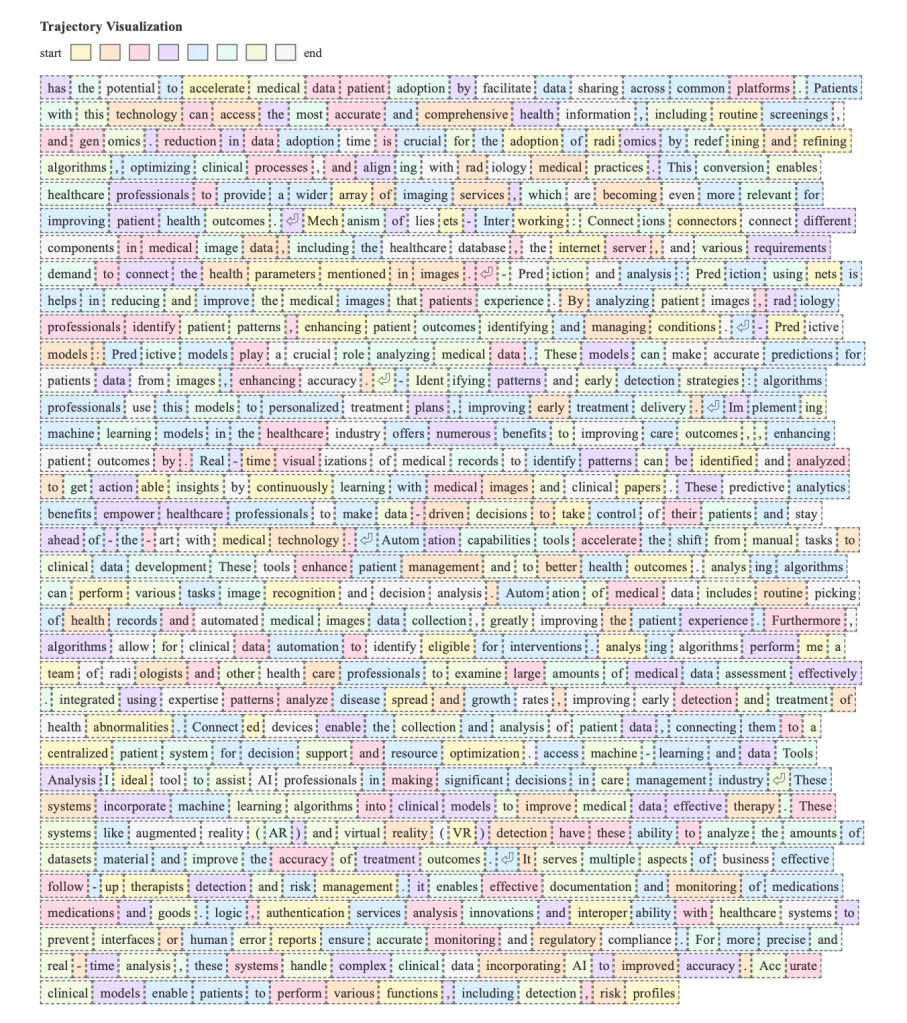

Pour ceux qui souhaitent approfondir ce sujet, le document complet est disponible sur arXiv, proposant des exemples concrets de performance et des visualisations fascinantes illustrant le cheminement de chaque token généré.

Les tokens stabilisés tôt sont représentés par des teintes claires, tandis que les modifications ultérieures apparaissent dans des nuances plus sombres.