Récemment, un rapport du Tech Transparency Project a mis en lumière la présence inquiétante d’applications de nudification accessibles tant sur l’App Store d’Apple que sur le Play Store de Google. Alors que le sujet des images générées par l’IA résonne fortement dans l’actualité, ces applications soulèvent des questions éthiques et de sécurité que peu semblent prendre au sérieux. Découvrons ce qui se cache derrière cette problématique grandissante.

La nudification via des applications en ligne

Les applications qui génèrent des images sexualisées, non consensuelles, attirent l’attention depuis quelque temps. Bien qu’il semble que ce soit un phénomène récent, il est évident que cette problématique existe depuis bien plus longtemps. Les outils de retouche d’images traditionnels ont toujours ouvert la porte à des contenus inappropriés. Cependant, l’apparition de l’IA a réduit le temps nécessaire pour créer ce type d’images à une simple fraction de seconde.

Avec l’essor des technologies, de nombreuses entreprises tentent depuis quelques années de tirer profit de cette nouvelle capacité. Certaines ne cachent même plus leurs intentions en faisant la promotion de leurs fonctionnalités de nudification. Pendant ce temps, des géants comme Apple se battent en justice pour maintenir une façade de sécurité dans leurs boutiques d’applications.

Alors qu’Apple souligne le coût de leurs services, ce qui inclut une revue rigoureuse des applications, des cas de négligence persistent. L’année dernière, des applications se faisant passer pour la célèbre Sora 2, développée par OpenAI, ont été mises en avant, certaines avec des frais d’abonnement exorbitants.

La récente attention médiatique autour des outils de nudification alimentée par des applications générées par l’IA a incité le Tech Transparency Project à enquêter. Le rapport révèle des éléments troublants témoignant de la facilité d’accès à ces applications, tant sur l’App Store que sur Google Play.

Selon le comuniqué, ces applications ont été téléchargées collectivement plus de 705 millions de fois à travers le monde, générant des revenus atteignant 117 millions d’euros. Apple et Google perçoivent une part de ces revenus, soulignant ainsi une complicité directe dans ce phénomène.

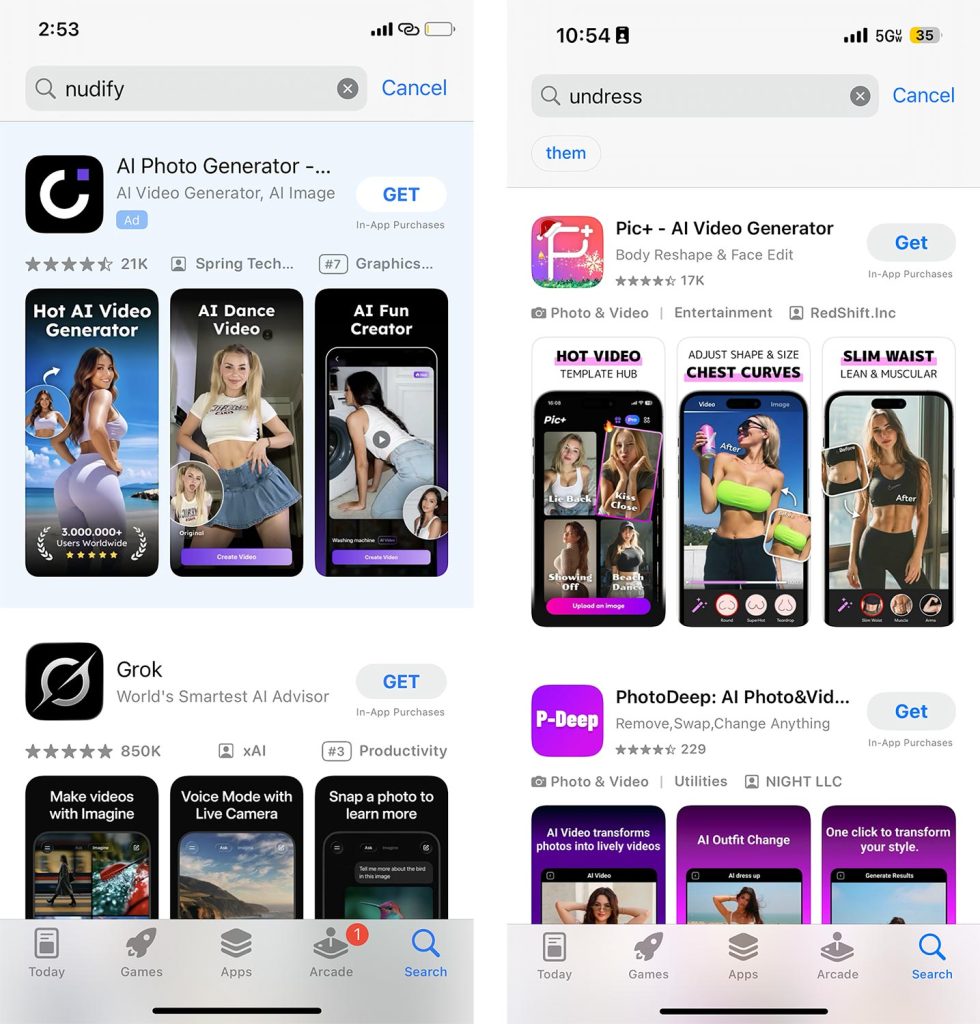

Malgré des politiques claires interdisant les contenus sexuels sur leurs plateformes, ces applications continuent d’y prospérer. Les recherches simples de termes tels que « nudifier » ou « dévêtir » révèlent des applications municipales, souvent bien référencées.

Facilité d’accès et implications éthiques

Apparemment, ces applications se divisent en deux catégories : celles qui génèrent des vidéos ou images basées sur des invites des utilisateurs et celles impliquant des superpositions de visages. Pour tester ces dernières, le Tech Transparency Project a utilisé des images générées par IA. Le résultat a montré que 55 applications Android et 47 applications iOS répondaient à leurs requêtes, ce qui pose questions sur l’âge approprié des utilisateurs.

Un exemple tiré de leurs tests révèle qu’une application sur iOS a bloqué une demande de création d’image suggestive mais a répondu favorablement à une demande moins explicite, pointant ainsi vers un véritable flou éthique. Des options comme « déchirer les vêtements » étaient clairement mises en avant sur les écrans d’accueil de ces applications.

Le rapport conclut que les entreprises derrière ces plateformes ne semblent pas faire un effort suffisant pour surveiller leurs applications ni faire respecter leurs politiques. Bien que les applications citées ne soient qu’une part de ce qui existe, elles mettent en lumière un problème sérieux qui mérite une attention accrue.