Cette semaine, OpenAI a dévoilé son modèle très attendu à poids ouvert, nommé gpt-oss. Ce modèle, qui peut être exécuté localement sur votre matériel, y compris sur les Mac équipés de la puce Apple, représente une avancée significative pour les passionnés d’IA. Découvrons ensemble comment démarrer et quelles sont les spécificités à prendre en compte.

Modèles et Mac

gpt-oss se décline en deux versions : gpt-oss-20b et gpt-oss-120b. La première est définie comme un modèle à poids ouvert de taille moyenne, tandis que la seconde est considérée comme un modèle lourd.

Le modèle de taille moyenne peut être exécuté sur des Mac équipés de ressources suffisantes. Toutefois, il faut noter que le modèle plus petit a tendance à halluciner davantage en raison de la différence de taille des ensembles de données. C’est un compromis pour un modèle plus rapide, capable de tourner sur des Macs haut de gamme.

Ce modèle réduit, accessible gratuitement, est idéal pour ceux qui possèdent un Mac suffisamment puissant et qui souhaitent explorer l’exécution de modèles de langage localement.

Il est crucial de comprendre les différences entre un modèle local et des plateformes comme ChatGPT. Par défaut, le modèle à poids ouvert ne possède pas beaucoup des fonctionnalités modernes des chatbots, ce qui peut limiter son efficacité.

OpenAI recommande un minimum de 16 Go de RAM pour faire fonctionner gpt-oss-20b. Les utilisateurs avec 32 Go de RAM ou plus bénéficieront d’une performance améliorée. Les retours d’expérience précoces indiquent que 16 Go de RAM est vraiment le seuil pour commencer à expérimenter.

Configuration et utilisation

Passons aux choses sérieuses : la mise en route est très simple.

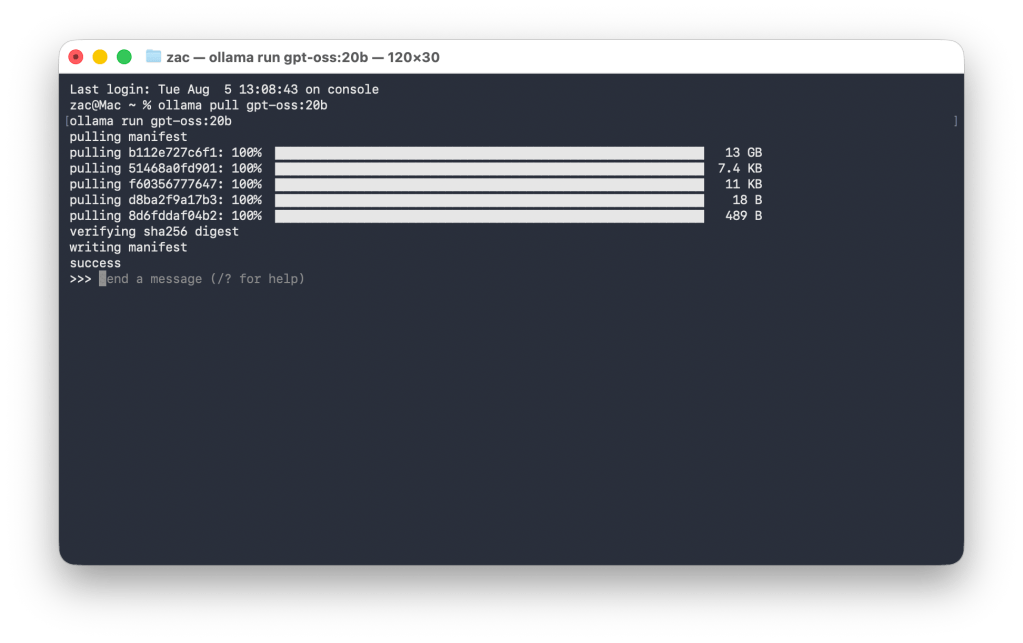

Commencez par installer Ollama sur votre Mac. C’est l’interface principale pour interagir avec gpt-oss-20b. Vous pouvez télécharger l’application sur le site ollama.com/download.

Ensuite, ouvrez le Terminal de votre Mac et entrez cette commande :

ollama pull gpt-oss:20b

ollama run gpt-oss:20b

Cela permettra à votre Mac de télécharger gpt-oss-20b, qui nécessite environ 15 Go de stockage.

Pour finir, lancez Ollama et sélectionnez gpt-oss-20b comme modèle. Vous pouvez même activer le mode avion dans les paramètres de l’application pour garantir que tout se déroule localement. Aucune identification n’est requise.

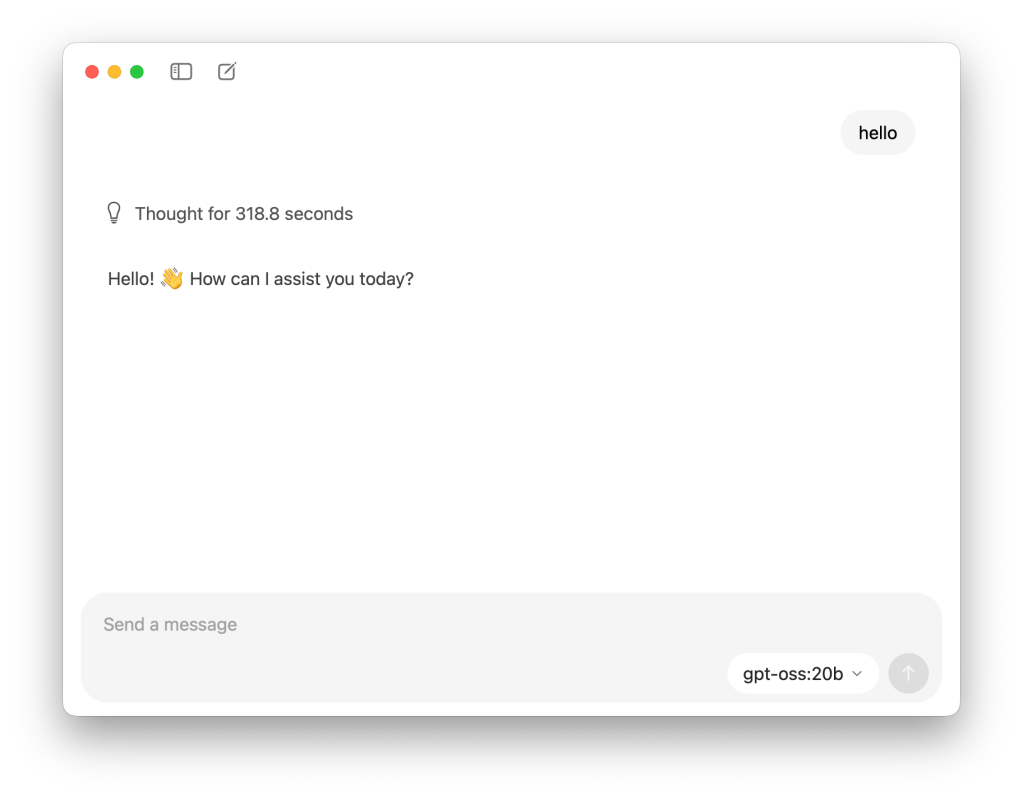

Pour tester gpt-oss-20b, saisissez simplement une invite dans le champ de texte et regardez le modèle en action. Les ressources matérielles joueront un rôle clé dans la performance ici, et attendez-vous à ce que votre Mac ralentisse pendant que le modèle réfléchit.

Mon Mac le plus performant est un MacBook Air 15 pouces avec 16 Go de RAM. Bien que le modèle fonctionne, il reste difficile à utiliser même pour une simple expérimentation. Répondre à « bonjour » a pris plus de cinq minutes, tandis que répondre à « qui était le 13e président » a nécessité environ 43 minutes. Autant dire qu’il est préférable d’avoir plus de RAM pour une utilisation prolongée.

Si vous souhaitez supprimer le modèle local et récupérer de l’espace disque, entrez cette commande dans le terminal :

ollama rm gpt-oss:20b