Une étude récente, coécrite par des chercheurs d’Apple, apporte un éclairage fascinant sur l’amélioration des modèles de langage. En utilisant une technique simple mais efficace, ces chercheurs ont réussi à augmenter les performances d’un modèle de langage open-source. Voici un aperçu des découvertes clés de cette recherche prometteuse.

Contexte pertinent

Une fois qu’un modèle de langage a été entraîné, une étape de raffinement est souvent appliquée, appelée apprentissage par renforcement avec retour d’information humain (RLHF). Cette méthode permet d’évaluer les réponses générées et de les ajuster en fonction des avis humains.

Les évaluateurs peuvent soit approuver, soit désapprouver les réponses fournies par le modèle. Au fil du temps, ce système d’évaluation permet à la machine de mieux comprendre quelles réponses sont jugées utiles. C’est ce processus qui est au cœur d’une approche plus large, visant à aligner les comportements des modèles de langage avec les attentes humaines.

L’étude d’Apple

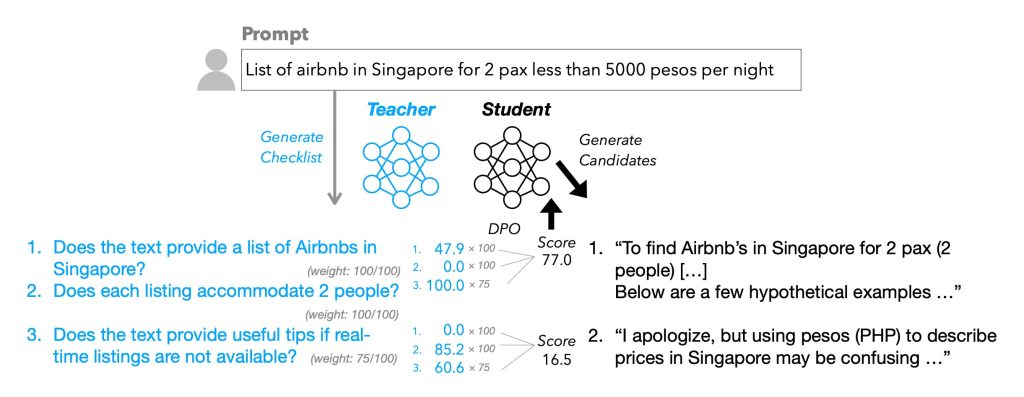

Intitulée « Les check-lists sont meilleures que les modèles de récompense pour l’alignement des modèles de langage », l’étude d’Apple introduit une méthode d’apprentissage par renforcement basé sur des check-lists, appelée Apprentissage par Renforcement à partir de Feedback de Check-list (RLCF).

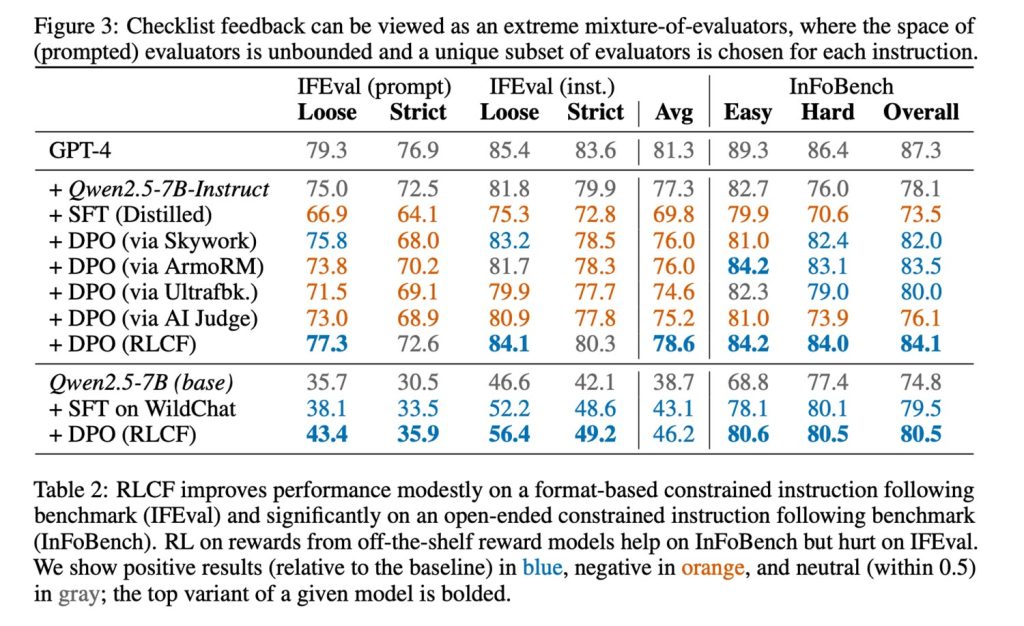

Ce système évalue les réponses sur une échelle de 0 à 100, selon leur capacité à satisfaire les éléments de la check-list établie. Les résultats initiaux sont encourageants. Selon les chercheurs, RLCF améliore les performances sur divers critères de référence importants.

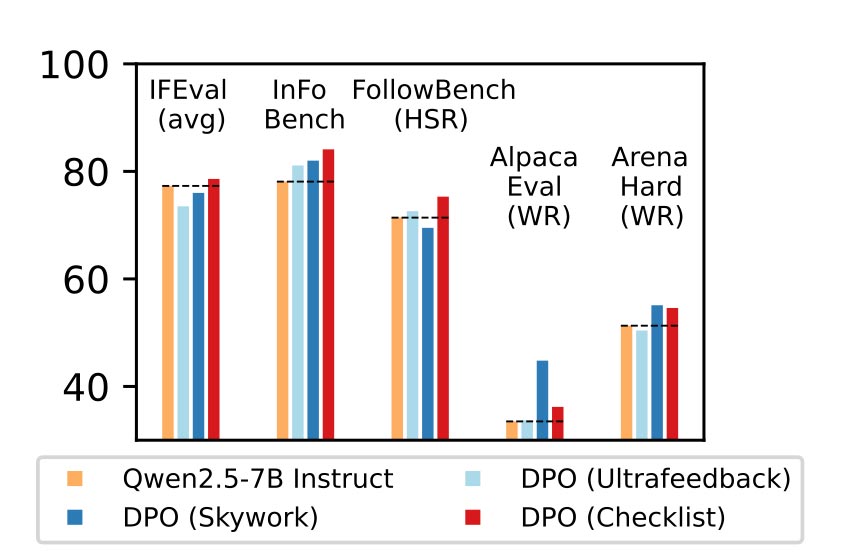

« Nous comparons RLCF avec d’autres méthodes d’alignement et c’est la seule à montrer une amélioration sur tous les benchmarks examinés, avec des augmentations notables dans plusieurs domaines. »

Ce qui est particulièrement captivant ici, c’est l’impact potentiel sur les assistants intelligents, qui devraient devenir la norme d’interaction dans l’avenir. Les utilisateurs attendent des modèles de langage qu’ils suivent fidèlement leurs instructions.

Génération de la check-list adaptée

Un autre aspect intéressant de l’étude réside dans la manière dont chaque check-list est créée, ainsi que dans l’établissement des poids d’importance entre chaque élément. Cela s’effectue grâce à l’assistance d’un modèle de langage.

Les chercheurs ont généré des « check-lists pour 130 000 instructions » afin de constituer un nouveau dataset baptisé WildChecklists. Chaque instruction faite par l’utilisateur est complétée par des critères concrets à valider. Une fois validés, ces critères permettent d’ajuster les modèles.

Les résultats montrent des gains significatifs de performance, prouvant ainsi l’efficacité de cette méthode d’évaluation. Si les systèmes sont correctement mis en place, des gains allant jusqu’à 8,2% ont été observés dans les tests.

Cependant, il est crucial de noter certaines limites liées à cette méthode. RLCF peut ne pas s’adapter à d’autres types de requêtes, et il nécessite un modèle plus puissant pour évaluer efficacement un modèle plus petit. Donc, l’expertise humaine reste incontournable.

Malgré ces limitations, cette étude ouvre la voie à des méthodes novatrices pour renforcer la fiabilité des interactions entre les utilisateurs et les assistants intelligents. À l’avenir, alors que ces technologies prennent de l’ampleur, la capacité à suivre les instructions sera plus essentielle que jamais.