Récemment, des chercheurs d’Apple ont publié une étude fascinante portant sur l’utilisation des modèles de langage de grande taille (LLMs) pour analyser les données audio et de mouvement. Cette recherche vise à mieux comprendre les activités des utilisateurs, permettant une analyse plus précise et contextualisée des comportements. Explorons ensemble les principales découvertes de cette étude captivante.

Une précision informatisée et non intrusive

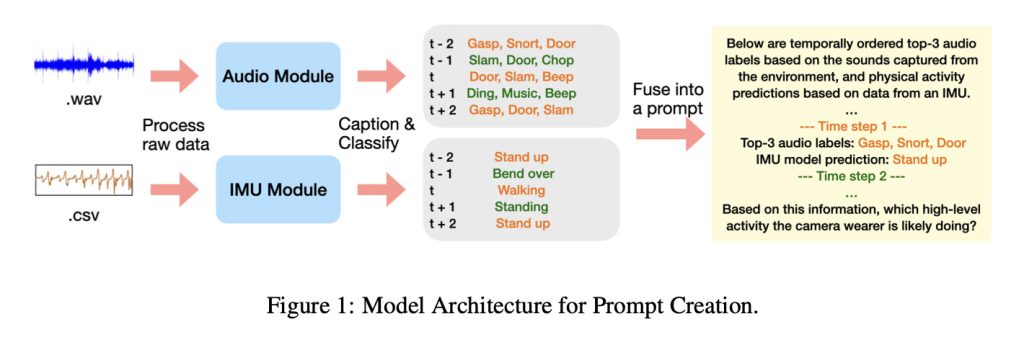

Intitulé “Using LLMs for Late Multimodal Sensor Fusion for Activity Recognition”, cet article fournit un éclairage sur la manière dont Apple envisage d’intégrer l’analyse des LLMs avec les données des capteurs traditionnels. Ce mariage technologique promet des avancées majeures dans l’analyse des activités, surtout lorsque les données collectées sont limitées.

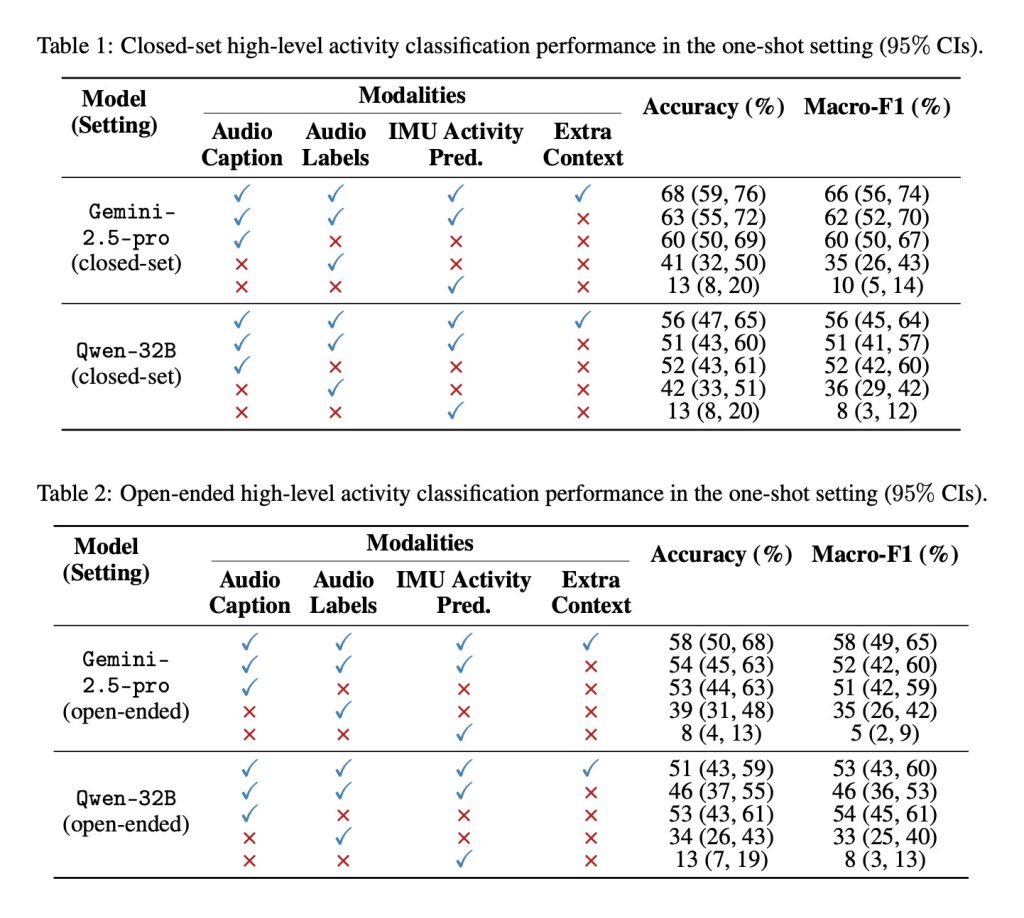

Les chercheurs soulignent que même sans formation spécifique, les LLMs peuvent déduire avec précision les activités d’un utilisateur à partir d’indices audio et de mouvement simples. Par exemple, en n’ayant qu’un seul exemple à analyser, leur performance se voit même améliorée de manière significative.

Un point crucial de cette étude réside dans l’utilisation de descriptions textuelles courtes, générées à partir de modèles audio et d’un modèle de mouvement basé sur un IMU (unité de mesure inertielle). Cette méthode permet une analyse sans intrusion, comme illustré ci-dessous :

Exploration approfondie des données

Les chercheurs ont utilisé le jeu de données Ego4D, qui regroupe une immense collection de médias filmés en première personne. Ce matériel couvre des heures d’activités de la vie quotidienne, allant de simples tâches ménagères à des activités sportives en extérieur.

Pour leur étude, ils ont sélectionné des échantillons de 20 secondes correspondant à douze activités majeures, comme le nettoyage, la cuisson, ou encore le sport. Ce choix a été fait pour représenter une large diversité d’activités domestiques et sportives, renforçant ainsi la pertinence de l’analyse.

Les données audio et de mouvement ont été traitées par des modèles réduits, produisant des descriptions textuelles. Ces résultats ont ensuite été analysés par différents LLMs (Gemini-2.5-pro et Qwen-32B) pour évaluer leur capacité à identifier les activités.

En fin de compte, Apple a comparé les performances des modèles dans deux contextes : un cadre fermé où une liste d’activités était fournie, et un cadre ouvert sans options prédéfinies. Cette approche a permis d’évaluer leur réaction selon différents types de données fournies.

Les résultats de cette enquête fournissent des indications prometteuses sur la synergie entre différents modèles pour améliorer la compréhension des données d’activité et de santé. Cela est particulièrement crucial lorsque les données brutes des capteurs ne suffisent pas à donner une image claire des activités de l’utilisateur.

Dans un geste de transparence, Apple a également partagé des matériaux complémentaires, y compris des identifiants de segments Ego4D et des exemples utilisés lors des expériences, facilitant ainsi la reproduction des résultats par d’autres chercheurs intéressés.