La recherche sur l’interaction entre l’homme et l’intelligence artificielle prend une tournure fascinante. Des chercheurs d’Apple se sont récemment penchés sur les attentes réelles des utilisateurs vis-à-vis des agents d’IA, ainsi que sur les meilleures manières de les faire interagir avec ces technologies. Leurs conclusions révèlent des pistes essentielles pour l’avenir de l’UX en matière d’IA.

Apple et le design des agents d’IA

Dans leur étude, Mapping the Design Space of User Experience for Computer Use Agents, quatre chercheurs d’Apple soulignent un fait crucial : en dépit des investissements massifs dans le développement des agents d’IA, certaines dimensions essentielles de l’expérience utilisateur sont souvent négligées. Comment les utilisateurs souhaitent-ils interagir avec ces agents ? Quel genre d’interface doit-on concevoir ?

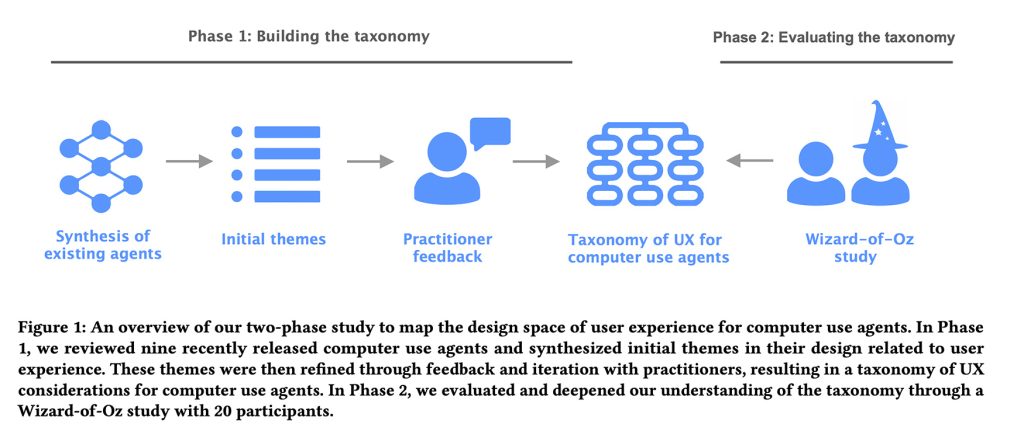

Pour répondre à ces questions, l’étude a été divisée en deux phases. La première consistait à identifier les principaux modèles UX et considérations de design intégrés dans les agents existants. Ensuite, des tests pratiques ont été réalisés à l’aide d’une méthode nommée Wizard of Oz, permettant d’affiner les concepts proposés.

En scrutant ces modèles de design dans le cadre d’interactions réelles, ils ont réussi à dresser un tableau des attentes des utilisateurs et à identifier les manquements des designs actuels.

Phase 1 : Analyse des agents

Les chercheurs ont examiné neuf agents, qu’ils aient été conçus pour le bureau, le mobile ou le web. Parmi eux figuraient :

- Claude Computer Use Tool

- Adept

- OpenAI Operator

- AIlice

- Magentic-UI

- UI-TARS

- Project Mariner

- TaxyAI

- AutoGLM

Pour renforcer leur analyse, ils ont collaboré avec huit professionnels du design, de l’ingénierie et de la recherche en UX et IA. Cela a permis de créer une taxonomie complète, comprenant quatre catégories principales, 21 sous-catégories et 55 fonctionnalités exemplaires.

Ces catégories englobaient :

- Requêtes Utilisateur : comment les utilisateurs saisissent leurs commandes

- Explications des Activités de l’Agent : quelles informations fournir à l’utilisateur sur les actions de l’agent

- Contrôle Utilisateur : comment les utilisateurs peuvent intervenir

- Modèle Mental et Attentes : comment aider les utilisateurs à comprendre les capacités de l’agent

Ce cadre englobait à la fois les éléments d’interface permettant aux agents de communiquer leurs plans et les moyens par lesquels ils présentent leurs capacités, signalent des erreurs ou laissent les utilisateurs intervenir.

Phase 2 : L’étude pratique

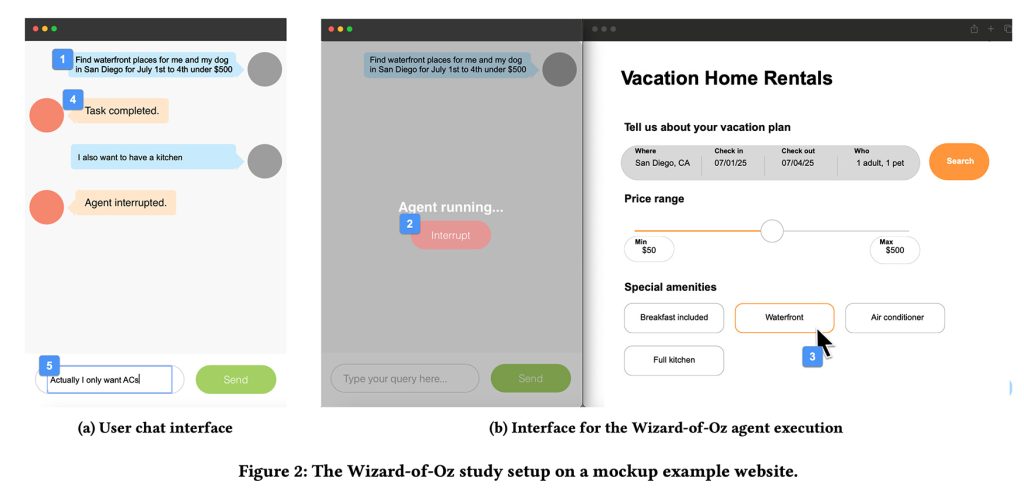

Pour la seconde phase, 20 utilisateurs familiers avec les agents d’IA ont été recrutés afin d’interagir avec un agent en utilisant une interface de chat. Ils avaient le choix entre deux tâches : réserver une location de vacances ou faire des achats en ligne.

Le processus était ingénieusement conçu. Les participants interagissaient à travers une interface de chat, tandis qu’un chercheur, de l’autre côté, jouait le rôle de l’agent. Les utilisateurs saisissaient leurs requêtes en langage naturel, tandis que le chercheur exécutait les tâches sur l’interface d’exécution.

Au cours de cette étude, chaque participant a été amené à réaliser six différentes fonctions, avec quelques pièges mis en place pour évaluer leur réaction face à des erreurs intentionnelles ou des comportements de l’agent. Un retour sur leur expérience a été demandé à la fin de chaque session.

Résultats principaux

Les résultats de l’étude sont enrichissants. Les utilisateurs souhaitent avoir une visibilité sur les actions des agents sans pour autant devoir gérer chaque détail, ce qui leur donnerait l’impression de faire le travail eux-mêmes.

Autre point notable, les attentes des utilisateurs varient selon qu’ils explorent des options ou effectuent des tâches familières. Leur besoin de transparence se renforce lorsque l’interface est nouvelle, avec un désir croissant d’explications et de pauses de confirmation, même pour des actions à faible risque.

Il est également intéressant de noter que la confiance des utilisateurs se dissipe rapidement lorsque les agents agissent sans prévenir ou commettent des erreurs. Par exemple, un agent qui omet d’informer sur des choix ambigus risque de perdre la confiance de l’utilisateur.

Ce travail offre de précieuses perspectives pour les développeurs d’applications désireux d’incorporer des capacités d’agents intelligents. La connaissance des préférences utilisateurs peut ouvrir un monde de possibilités pour améliorer l’interaction homme-machine.