Un récent projet soutenu par Apple, réalisé en collaboration avec l’Université Aalto en Finlande, présente ILuvUI, un modèle de vision-langage conçu pour comprendre les interfaces d’applications mobiles à partir de captures d’écran et de conversations en langage naturel. Cet article explore ce que cela implique et comment cette innovation a vu le jour.

ILuvUI : une IA qui surpasse son modèle d’origine

Dans l’étude intitulée ILuvUI : Instruction-tuned LangUage-Vision modeling of UIs from Machine Conversations, l’équipe aborde un défi majeur en interaction homme-machine : enseigner aux modèles d’IA à raisonner sur les interfaces utilisateur comme le ferait un humain, c’est-à-dire à la fois visuellement et sémantiquement.

“Comprendre et automatiser les actions sur les interfaces est une tâche complexe, car les éléments d’interface, tels que les listes, les cases à cocher et les champs de texte, renferment de nombreuses couches d’informations au-delà de leur interactivité. Bien que les LLM aient prouvé leur capacité à comprendre des instructions en langage naturel, se baser uniquement sur des descriptions textuelles d’interfaces laisse de côté des informations visuelles cruciales.”

Actuellement, comme l’expliquent les chercheurs, la plupart des modèles vision-langage sont formés sur des images naturelles, comme des animaux ou des panneaux de signalisation, ce qui limite leur performance sur des environnements structurés comme les interfaces d’applications.

“Fusionner les informations visuelles et textuelles est essentiel pour comprendre les interfaces, car cela reflète la manière dont les humains interagissent avec leur environnement. Les modèles de vision-langage acceptent des entrées multimodales d’images et de texte, mais leur efficacité sur des tâches d’interface reste inférieure comparée aux images naturelles en raison du manque d’exemples d’UI dans leurs données d’apprentissage.”

Pour remédier à cette lacune, les chercheurs ont affiné le modèle de vision-langage open-source LLaVA et ont ajusté sa méthode d’apprentissage pour se spécialiser dans les interfaces utilisateur.

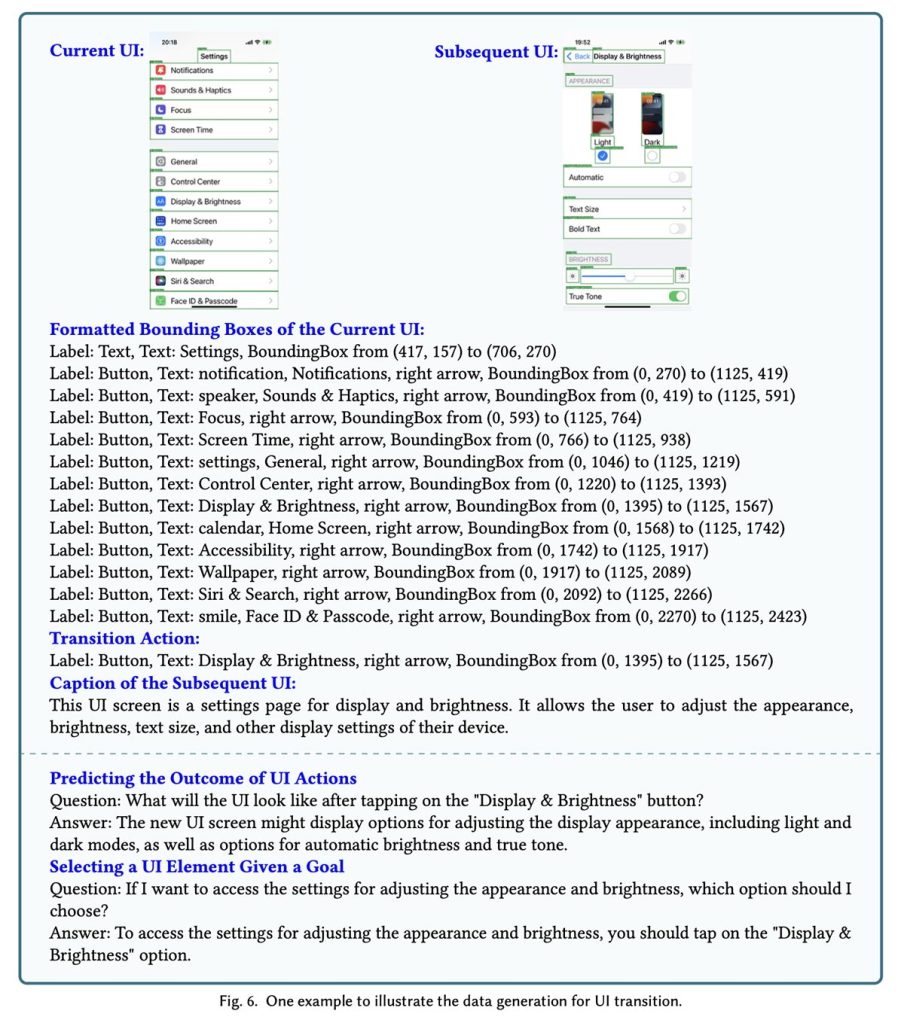

Ils ont formé le modèle à partir de paires texte-image générées synthétiquement en suivant des exemples modèles. Le jeu de données final comprenait des interactions de type Q&A, des descriptions détaillées d’écran, des résultats d’actions prévues et même des plans d’actions en plusieurs étapes.

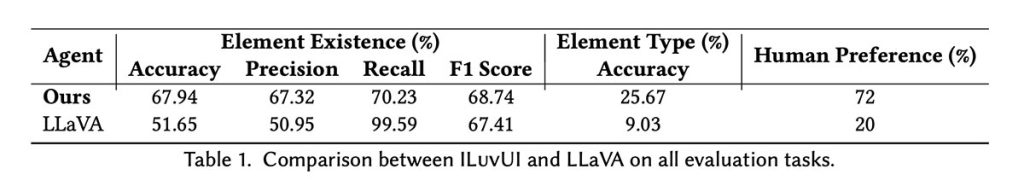

Une fois entraîné, le modèle ILuvUI a surpassé le LLaVA d’origine tant dans les tests de performance machine que dans les préférences des utilisateurs.

Par ailleurs, ce modèle n’exige pas que l’utilisateur spécifie une zone d’intérêt dans l’interface. ILuvUI comprend le contexte de l’écran dans son ensemble à partir d’un simple prompt.

“ILuvUI n’exige pas de zone d’intérêt et accepte un prompt textuel en plus de l’image de l’interface, ce qui lui permet de répondre à des cas d’utilisation tels que les questions visuelles.”

Comment les utilisateurs bénéficieront-ils de cette innovation ?

Les chercheurs d’Apple affirment que leur méthode pourrait être précieuse pour l’accessibilité et pour les tests automatisés des interfaces. Ils ajoutent qu’ILuvUI repose sur des composants ouverts, mais que les travaux futurs pourraient se concentrer sur l’intégration de codeurs d’images plus grands, une meilleure gestion des résolutions et des formats de sortie compatibles avec les frameworks d’UI existants, comme le JSON.

Pour ceux qui suivent l’évolution de la recherche en IA chez Apple, il est intéressant de noter qu’une étude récente a exploré la possibilité pour les modèles d’IA non seulement de comprendre, mais aussi d’anticiper les conséquences des actions effectuées dans les applications.

En combinant ces deux avancées, l’avenir semble prometteur, surtout pour ceux qui dépendent de l’accessibilité pour naviguer sur leurs appareils ou qui espèrent que le système d’exploitation puisse gérer de manière autonome certains aspects complexes de leurs flux de travail.