Les avancées technologiques d’Apple ne cessent d’étonner, notamment dans le domaine de l’accessibilité. Bien qu’il y ait de nombreuses spéculations sur l’avenir des dispositifs portables avec caméra, un projet prometteur a récemment émergé : SceneScout. Ce prototype de recherche, développé en collaboration avec l’Université de Columbia, illustre comment l’intelligence artificielle peut transformer l’expérience des utilisateurs malvoyants ou non-voyants.

Une approche innovante pour l’accessibilité

La recherche menée par Apple et l’Université de Columbia vise à faciliter les déplacements des personnes aveugles ou malvoyantes dans des environnements inconnus. Ces utilisateurs peuvent souvent ressentir une appréhension à l’idée de voyager seuls. La plupart des outils actuels se concentrent sur la navigation in situ, mais peu d’entre eux offrent un contexte visuel détaillé. SceneScout cherche à combler cette lacune.

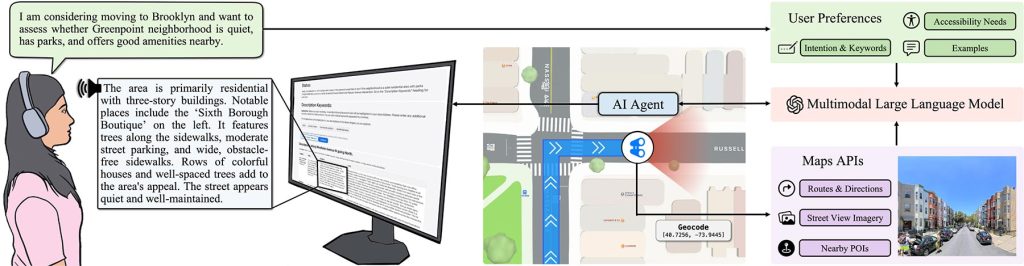

Le projet combine les APIs d’Apple Maps avec un modèle de langage multimodal afin de générer des descriptions interactives des images de Street View. Les utilisateurs peuvent ainsi explorer un itinéraire complet ou un quartier, bénéficiant de descriptions de rue adaptées à leurs besoins spécifiques.

Modes d’utilisation et potentiel transformateur

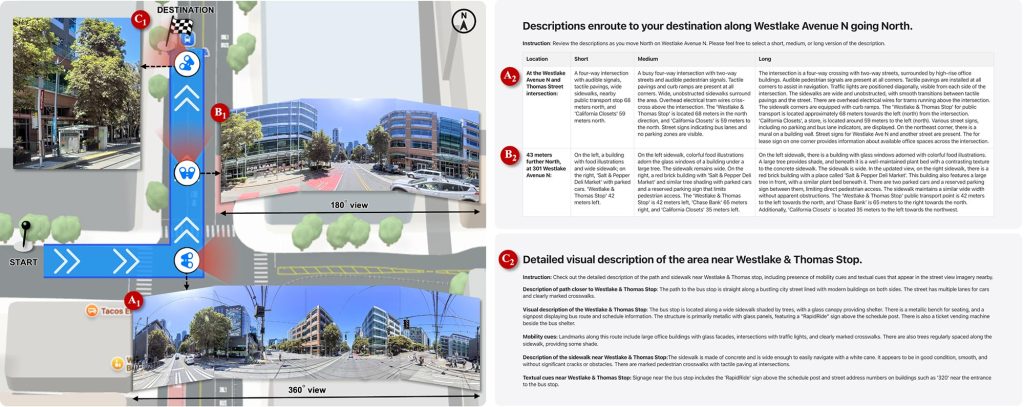

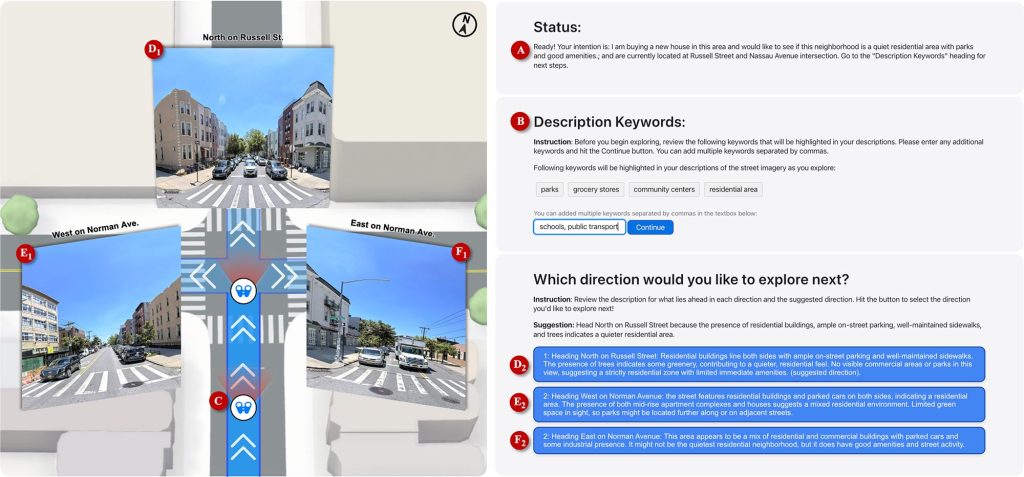

SceneScout propose deux modes principaux : le Route Preview et l’Exploration Virtuelle. Le premier permet aux utilisateurs d’obtenir une vision d’ensemble de ce qu’ils rencontreront sur leur chemin, notamment la qualité des trottoirs et les intersections. Le second, plus ouvert, permet aux utilisateurs de décrire ce qu’ils recherchent, comme un quartier calme avec accès à des parcs.

En arrière-plan, SceneScout utilise un agent basé sur GPT-4o, ancré dans des données cartographiques réelles et des images panoramiques d’Apple Maps. Ce système interprète la vue d’un piéton, génère des descriptions structurées et les présente dans un format accessible pour les lecteurs d’écran.

Les premiers tests ont révélé un potentiel intéressant, mais également des limites. Les utilisateurs ont noté que bien que 72 % des descriptions générées étaient précises, certaines contenaient des erreurs, comme des informations sur des feux de circulation inexistants. D’autres ont souligné le besoin d’un langage plus objectif pour éviter des malentendus.

See more