Apple continue d’innover dans le domaine des modèles de langage avec une nouvelle approche qui améliore la rapidité des réponses tout en maintenant une qualité d’écriture élevée. Ce développement promet d’accélérer considérablement le traitement des requêtes, une avancée qui pourrait transformer la façon dont interagissent les utilisateurs avec ces technologies. Plongeons dans les détails de cette recherche fascinante.

Le fonctionnement des modèles de langage

Les modèles de langage, souvent appelés LLM, génèrent traditionnellement du texte un token à la fois. Ce processus peut s’avérer lent, car chaque étape dépend des précédentes pour garantir la cohérence et la pertinence des réponses. Par exemple, pour écrire “Le chat est noir”, le modèle évalue chaque mot en fonction de ce qui a déjà été généré.

Lorsqu’il formule une phrase, le modèle détermine les probabilités de chaque mot potentiel à partir de tout ce qu’il a déjà écrit, ainsi que des données d’apprentissage. Ce processus, connu sous le nom d’autoregression, peut être inefficace lorsqu’il s’agit de générer des textes plus longs et complexes.

L’innovante prédiction multi-token

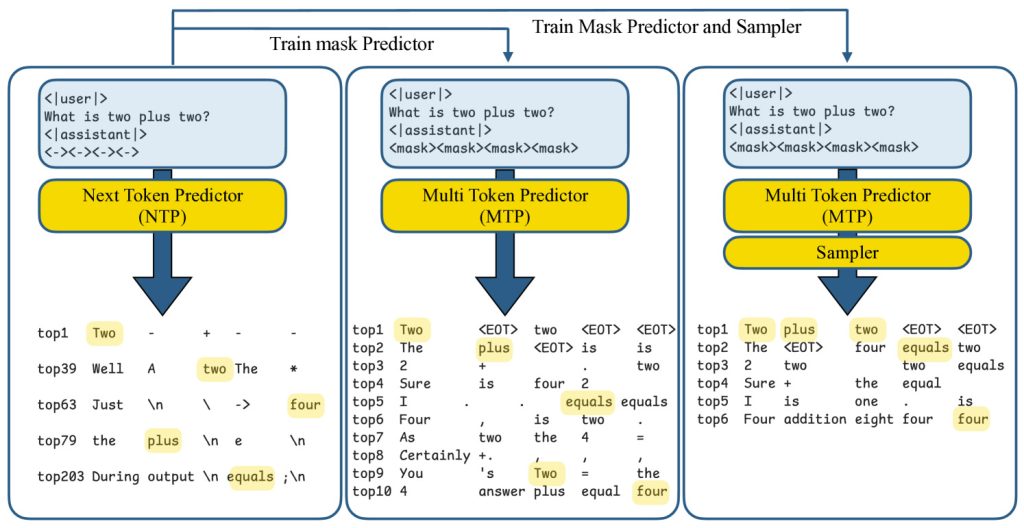

Dans leur étude intitulée « Your LLM Knows the Future: Uncovering Its Multi-Token Prediction Potential », l’équipe d’Apple a découvert que, bien que ces modèles soient généralement formés pour prédire un seul token, ils possèdent également des informations utiles concernant plusieurs tokens à venir. Pour exploiter ce potentiel, ils ont développé un cadre de travail appelé “prédiction multi-token” (MTP).

Cette méthode permet au modèle de générer plusieurs tokens simultanément. En intégrant des “tokens masqués” dans les requêtes, le modèle peut par exemple remplir “Le chat est ” par “très fluffy” en une seule opération. Au fur et à mesure qu’il écrit, il anticipe plusieurs mots à la fois, tout en vérifiant la cohérence avec l’autoregression traditionnelle.

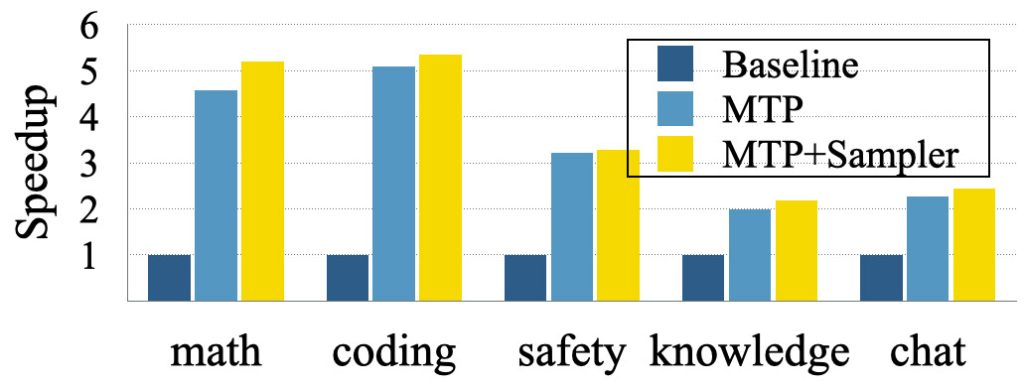

Les tests réalisés avec le modèle open-source Tulu3-8B ont montré que le modèle pouvait prédire jusqu’à 8 tokens supplémentaires, entraînant des gains de vitesse de 2 à 3 fois sur des tâches générales, et même jusqu’à 5 fois pour des domaines plus prévisibles comme la programmation et les mathématiques. Ce progrès s’est accompagné d’une absence de dégradation dans la qualité de génération, grâce à une technique efficace appelée gated LoRA adaptation.

Cette avancée d’Apple ouvre la voie à des interactions plus fluides et rapides avec les modèles de langage, offrant ainsi des perspectives prometteuses pour le futur de l’intelligence artificielle.