Apple pourrait bientôt être sous le feu des projecteurs à cause de ses pratiques en matière d’intelligence artificielle (IA). Un dépôt récent auprès de la Securities and Exchange Commission (SEC) des États-Unis attire l’attention sur la manière dont la marque gère les données externes pour former ses modèles d’IA. Ce document, soumis par le National Legal and Policy Center (NLPC), vient ajouter une touche de tension à la réunion annuelle des actionnaires prévue pour le 25 février prochain.

Un appel à la transparence

La proposition du NLPC, identifiée comme la Proposition No. 4 dans les documents proxy d’Apple pour 2025, demande à la firme de fournir un rapport détaillant ses politiques concernant l’acquisition de données pour l’IA. En effet, le NLPC souhaite que la société aborde plusieurs points cruciaux :

- Les risques associés à la collecte de données inappropriées pour la formation des modèles d’IA.

- Les garanties de confidentialité mises en place dans le développement de l’IA.

- Les mesures adoptées pour s’assurer que les résultats générés par l’IA respectent les normes légales et éthiques.

Le NLPC insiste sur le fait qu’Apple, reconnu pour son positionnement en matière de confidentialité, devrait adopter un standard plus élevé dans l’éthique de l’IA.

Une stratégie contestée

L’argumentaire du NLPC ne mâche pas ses mots pour résumer la stratégie d’Apple dans le domaine de l’IA. D’une part, Apple cultive habilement son image de défenseur de la vie privée. D’autre part, le potentiel de monétisation de sa vaste base d’utilisateurs semble conduire l’entreprise à externaliser des pratiques peu éthiques. Par exemple, la firme entretient un partenariat avec Alphabet, son principal concurrent, pour que Google soit le moteur de recherche par défaut sur ses produits. Selon les estimations, cet accord pourrait rapporter à Apple 25 milliards d’euros, représentant ainsi 20 % de son bénéfice d’exploitation.

Par ailleurs, cette collaboration soulève des préoccupations en matière de concurrence, tout en permettant à Alphabet de collecter une quantité considérable de données sur les utilisateurs d’Apple.

L’avenir en question

Pour l’instant, Apple aborde l’IA de manière plus mesurée que ses rivaux. La société privilégie l’intelligence de dispositif et l’apprentissage automatique axé sur la confidentialité. Son modèle de Private Cloud Compute est conçu pour ne transmettre aucune donnée personnelle lorsque les utilisateurs interagissent avec leur intelligence.

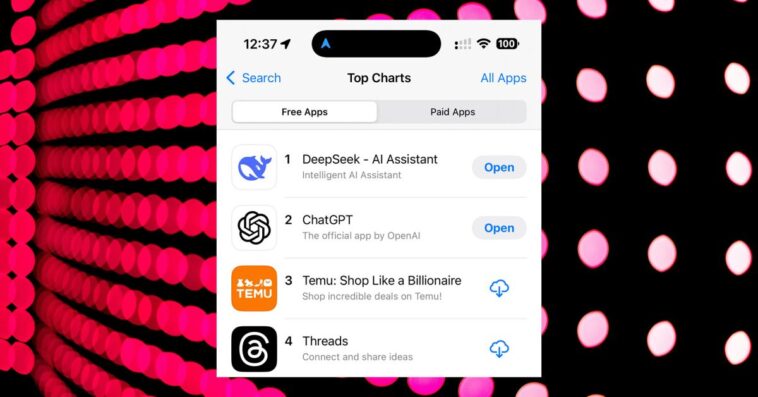

Néanmoins, lorsque l’IA d’Apple fait appel à des intégrations tierces, la politique de confidentialité semble s’effacer. Pour le moment, OpenAI avec ChatGPT est le seul partenariat officiel, mais des discussions pour intégrer Google Gemini sont ouvertes. Apple exige la permission explicite des utilisateurs pour activer ces intégrations d’IA tierce.

Que va-t-il se passer ensuite ?

Il est fort probable que cette proposition ne reçoive pas le support des actionnaires. En général, Apple recommande de ne pas appuyer de telles propositions, ce qui entraîne leur échec. Cependant, les accusations concernant l’externalisation de "pratiques non éthiques" dans le développement de sa technologie d’IA sont à prendre en considération.

Les analystes louent Apple pour sa décision de ne pas précipiter des investissements dans l’IA, se concentrant plutôt sur la préservation de son éthique et de son image. Les mois à venir seront cruciaux pour déterminer si Apple devra davantage clarifier ses politiques en matière d’acquisition de données pour ses projets IA.