Les avancées technologiques révolutionnent notre manière d’interagir avec les vidéos. Apple a fait un pas de géant en développant une version optimisée du modèle SlowFast-LLaVA, capable d’analyser et de comprendre les vidéos longues avec une efficacité surprenante. Cette innovation démontre que même des modèles plus petits peuvent dépasser des géants, remettant en question nos idées reçues sur la puissance des réseaux de neurones.

Les aspects techniques

Pour faire simple, un modèle de langage machine (LLM) apprenant à analyser des vidéos doit découper ces dernières en différentes images. Il s’agit d’extraire des éléments visuels, d’analyser leur changement au fil du temps et d’harmoniser cette information avec des descriptions textuelles. C’est un défi complexe, surtout lorsque l’on considère la redondance des images.

Les systèmes traditionnels analysent chaque image, ce qui entraîne une surcharge d’informations. Cela pousse souvent le LLM à dépasser sa fenêtre de contexte, sa limite de traitement d’informations. En prime, cela peut fausser les réponses en ignorant les premiers éléments de données.

Des méthodes plus efficaces existent pour la formation des LLM vidéo, et de nouvelles recherches explorent des voies prometteuses. Néanmoins, la complexité du sujet demeure un point crucial dans l’étude d’Apple.

L’étude d’Apple

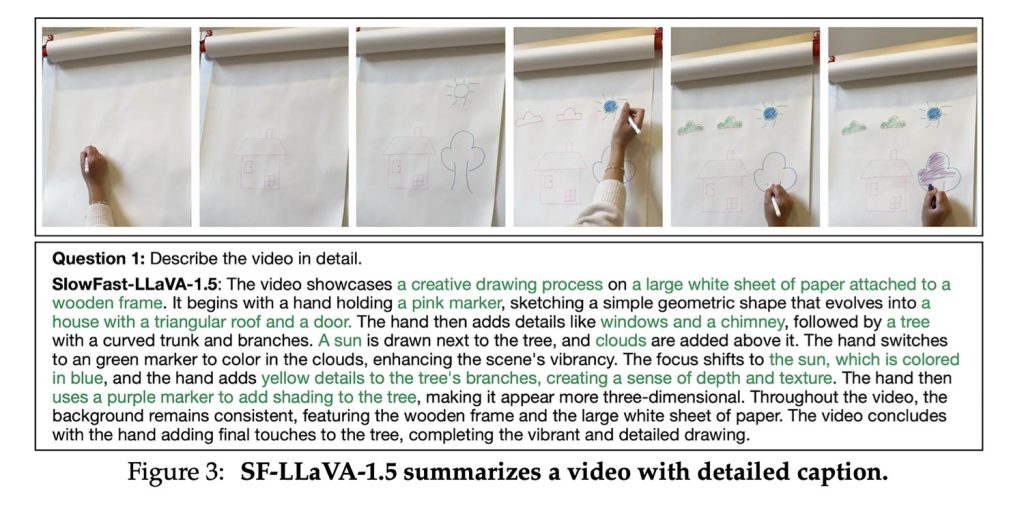

Les chercheurs d’Apple, dans leur étude intitulée SlowFast-LLaVA-1.5, abordent les défis des modèles vidéo actuels. Ils soulignent trois limitations majeures :

- Une dépendance excessive à de longues fenêtres de contexte et à un grand nombre d’images, ce qui n’est pas optimal pour les petits modèles.

- Des processus de formation complexes, souvent intrusifs avec des ensembles de données privés, difficiles à reproduire.

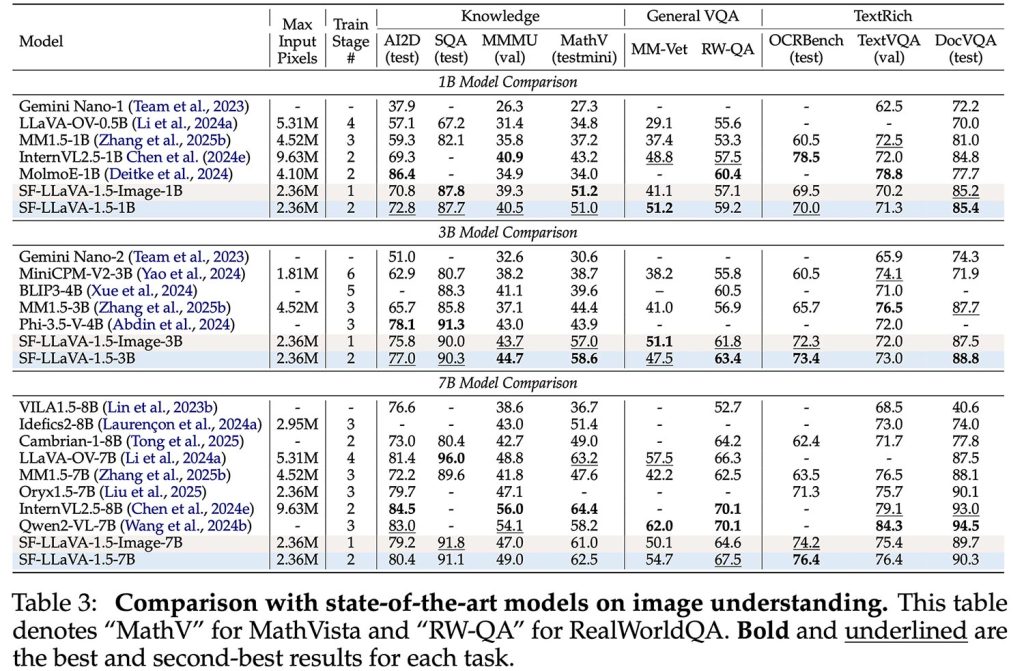

- Des modèles concentrés exclusivement sur les tâches vidéo, alors qu’une compréhension d’images enrichit grandement l’analyse.

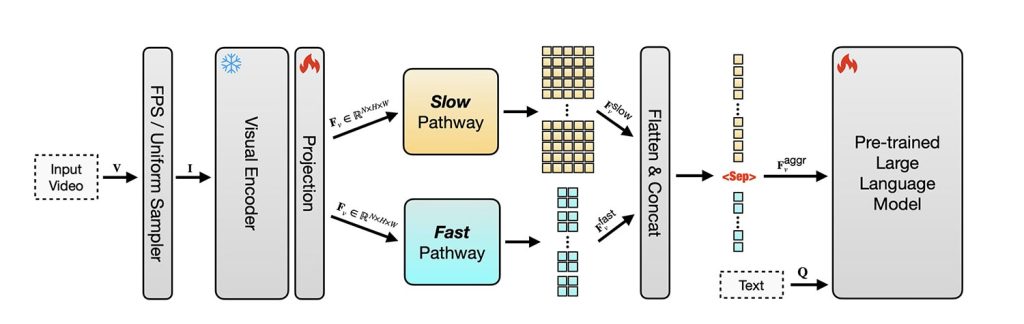

Pour surmonter ces obstacles, Apple a adapté le modèle SlowFast-LLaVA. Ils ont d’abord affiné ce modèle sur des images, avant d’ajouter une formation conjointe sur des images et vidéos, tirant parti d’ensembles de données publics.

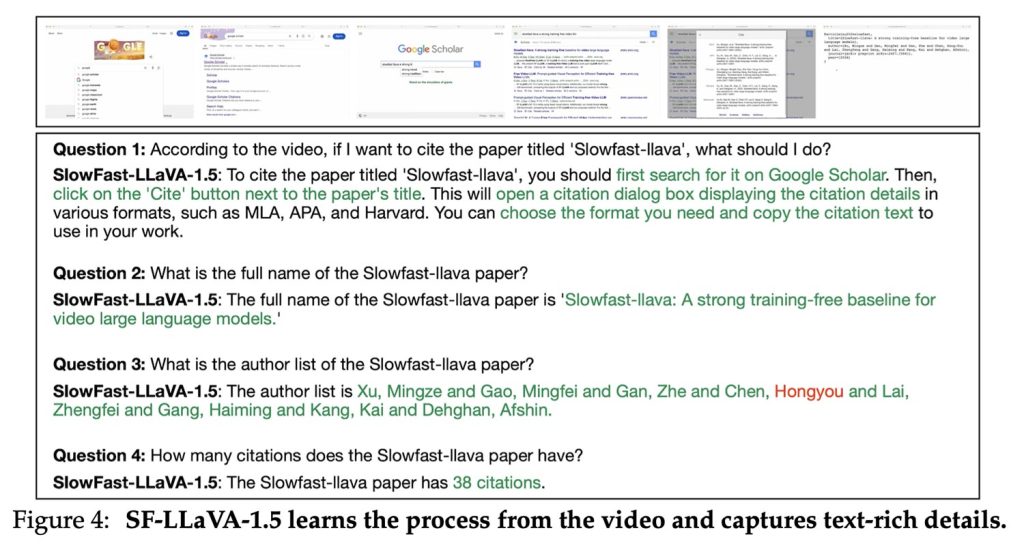

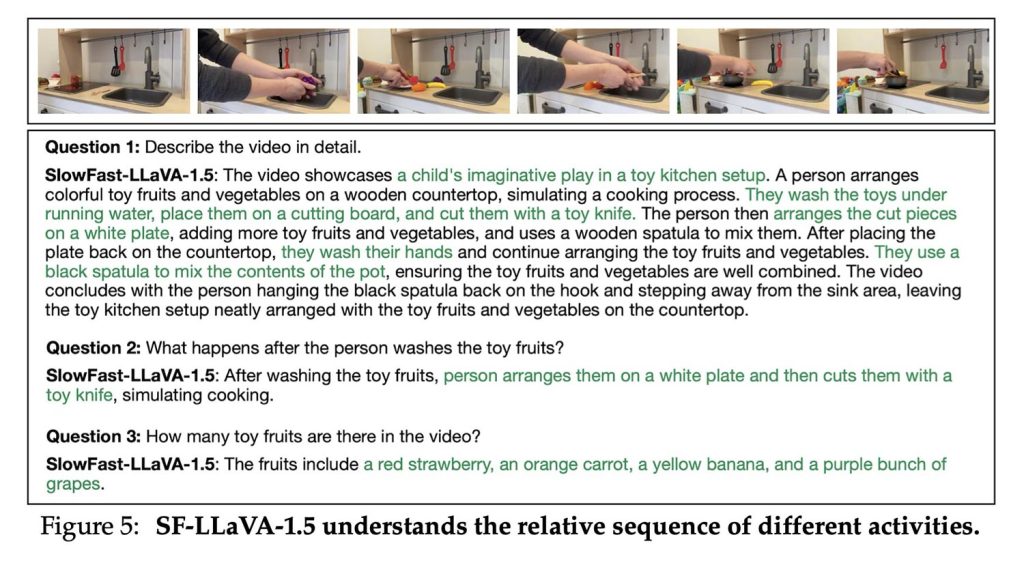

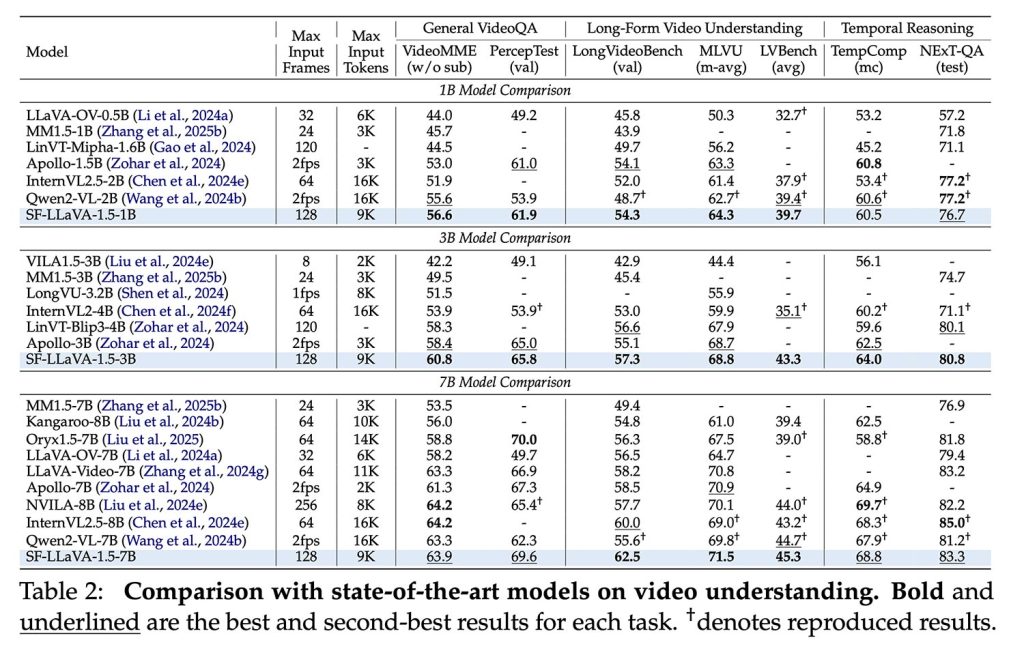

Au final, ce nouveau modèle, SF-LLaVA-1.5, se décline en trois versions de 1, 3 et 7 milliards de paramètres. Ses performances surpassent souvent celles de modèles beaucoup plus gros, comme l’indiquent les résultats de benchmarks sur des vidéos longues.

Les tests sur des benchmarks comme LongVideoBench ont fait ressortir des scores de pointe, illustrant la capacité de ce modèle à gérer des vidéos longues tout en restant performant sur des tâches d’image variées.

Des limites persistantes

Malgré les prouesses d’SF-LLaVA-1.5, il subsiste des contraintes, notamment une longueur maximale de 128 images d’entrée. Cela signifie que quel que soit le clip analysé, le modèle se limite à ces 128 cadres. Les implications ? Le risque de négliger des moments critiques dans des vidéos plus longues.

Les chercheurs reconnaissent que cette approche peut affecter la précision du modèle concernant la vitesse de lecture des vidéos. Ils notent que des ajustements supplémentaires, notamment du encodeur visuel, sont envisageables, mais demeurent techniques due aux contraintes de mémoire GPU.

Malgré ces défis, le modèle reste à la pointe dans son domaine, ayant été formé uniquement sur des ensembles de données publiques. SF-LLaVA-1.5 est désormais un modèle open-source, accessible sur des plateformes comme GitHub.