Récemment, une polémique a éclaté autour de la fonctionnalité de résumé d’Apple Intelligence, suite à une erreur monumentale attribuée à un incident tragique. Cette situation a suscité des débats sur la fiabilité des outils d’intelligence artificielle, et la nécessité d’une réflexion sur leur utilisation dans le domaine de l’information.

La polémique autour de Luigi Mangione

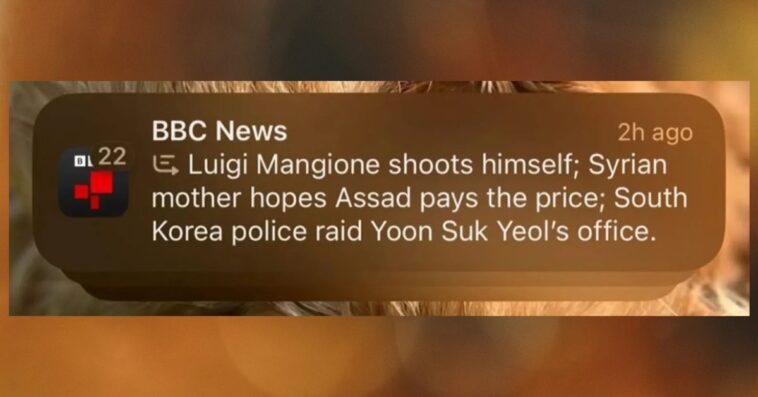

L’affaire a démarré lorsque la fonctionnalité de résumé a déclaré que Luigi Mangione, principal suspect dans le meurtre du PDG de United Health, avait mis fin à ses jours. Ce type d’information, erronée et alarmante, a immédiatement frappé les médias et suscité des inquiétudes quant à la véracité des alertes diffusées.

Luigi Mangione s’est tiré une balle.

La BBC, célèbre pour sa rigueur journalistique, a rapidement réagi. Dans une déclaration, un porte-parole a affirmé que la confiance du public envers leurs informations est primordiale. Ils ont donc contacté Apple pour élever leur préoccupation et obtenir des réponses concernant cette défaillance.

“La BBC est le média d’information le plus fiable au monde”, a déclaré un représentant.

Malheureusement, Apple n’a pas encore répondu aux demandes de clarification, laissant planer une atmosphère d’incertitude autour de la gestion de la situation.

Le rapport entre l’intelligence artificielle et le journalisme

Reporters Sans Frontières (RSF) a clairement exprimé ses inquiétudes suite à cet incident. Leur communiqué appelle à reconsidérer l’utilisation des outils d’intelligence artificielle dans le domaine de l’information. Ils mettent en lumière que des systèmes comme celui d’Apple sont encore trop instables pour produire des nouvelles fiables.

RSF souligne que les IA ne peuvent pas se substituer à un processus journalistique rigoureux.

Le responsable technologique de RSF, Vincent Berthier, a insisté sur le fait que les AIs, en tant que « machines à probabilité », ne devraient pas être utilisées pour diffuser des informations cruciales. Il a appelé Apple à agir avec responsabilité pour éviter de futures incidents similaires qui pourraient éroder la crédibilité des médias.

“La production automatique d’informations fausses représente un danger pour le droit du public à une information fiable,” a-t-il déclaré.

La situation actuelle met en lumière le défi majeur que représente l’intégration de l’intelligence artificielle dans le paysage médiatique. Les outils d’IA, bien qu’innovants, ne doivent pas compromettre l’intégrité de l’information transmise aux citoyens. Cette situation restera donc à surveiller de près.